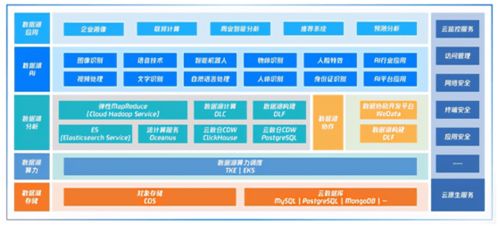

随着企业数据量的爆炸式增长,大数据平台已成为现代信息技术架构的核心。在构建大数据平台的过程中,数据处理和存储服务环节常常面临诸多挑战。这些问题不仅影响平台性能,还可能阻碍数据价值的有效挖掘。以下将针对数据处理和存储服务中常见的问题进行梳理,并提出相应的解决方案。

一、数据处理服务常见问题

1. 数据质量问题

数据质量问题是大数据处理中的首要难题。由于数据来源多样、格式不一,经常出现数据不一致、重复、缺失或错误的情况。例如,来自不同业务系统的用户数据可能存在格式差异,导致数据清洗和整合困难。应对措施包括建立统一的数据标准、实施数据质量监控流程,以及引入数据清洗工具(如Apache Nifi或Talend)自动化处理异常数据。

2. 实时处理能力不足

许多业务场景需要实时数据处理,如金融风控或物联网监控。传统批处理架构难以满足低延迟要求。常见问题包括处理延迟高、吞吐量不足。解决方案是采用流处理框架,如Apache Kafka、Flink或Spark Streaming,结合事件驱动架构,提升实时数据摄入和处理效率。

3. 计算资源调度与优化困难

大数据处理任务通常需要分布式计算,但资源分配不当会导致任务拥堵或资源浪费。例如,在Hadoop或Spark平台上,任务调度不均可能引发节点过载。优化方法包括使用YARN或Kubernetes进行动态资源管理,并监控任务性能以调整并行度和内存分配。

4. 数据安全与合规风险

数据处理涉及敏感信息时,易面临数据泄露或违规风险。例如,未加密的数据传输或存储可能违反GDPR等法规。应对策略包括实施端到端加密、访问控制机制,以及定期进行安全审计。

二、数据存储服务常见问题

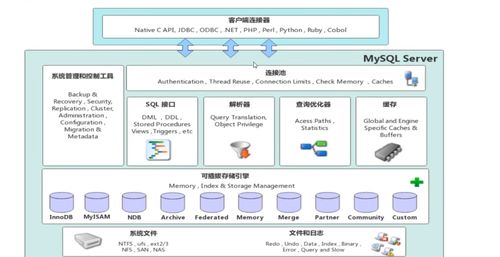

1. 存储架构选择不当

大数据存储需平衡成本、性能和可扩展性,但常见问题包括选型错误。例如,使用关系型数据库存储非结构化数据会导致效率低下。建议根据数据特性(如结构化、半结构化或非结构化)选择合适的存储方案,如HDFS用于海量文件存储,NoSQL数据库(如HBase、Cassandra)处理高并发读写,而数据湖架构(如Delta Lake)支持多样数据类型的统一管理。

2. 数据一致性与可用性挑战

在分布式存储系统中,如HDFS或云存储,网络分区或节点故障可能导致数据不一致或服务中断。例如,CAP理论中的权衡问题常使系统在一致性和可用性之间难以取舍。解决方法包括采用复制和容错机制(如HDFS的副本策略),或使用分布式事务工具(如Apache ZooKeeper)来协调数据一致性。

3. 存储成本控制问题

大数据存储往往占用大量资源,成本高昂。常见问题包括数据冗余、冷热数据未分层存储。优化方案包括实施数据生命周期管理,将热数据存入高性能存储(如SSD),冷数据迁移到低成本对象存储(如AWS S3),并定期清理无用数据。

4. 扩展性与性能瓶颈

随着数据量增长,存储系统可能遇到扩展瓶颈,如单点故障或I/O性能下降。例如,传统NAS系统难以水平扩展。应对措施是采用分布式文件系统或云原生存储,支持弹性扩展,并通过缓存技术(如Redis)提升读写速度。

构建大数据平台时,数据处理和存储服务是核心环节,企业需从数据质量、实时性、资源管理、安全合规、架构选型、一致性、成本控制和扩展性等多个维度入手,结合具体业务需求,选择合适的技术栈和最佳实践。通过持续监控和优化,可以有效克服这些问题,释放数据的最大价值,推动数字化转型。